AMD เปิดตัวการ์ดเร่ง AI รุ่นใหม่ Instinct MI350P แบบ PCIe ช่วยให้องค์กรอัปเกรดบนเซิร์ฟเวอร์เดิมได้เลย

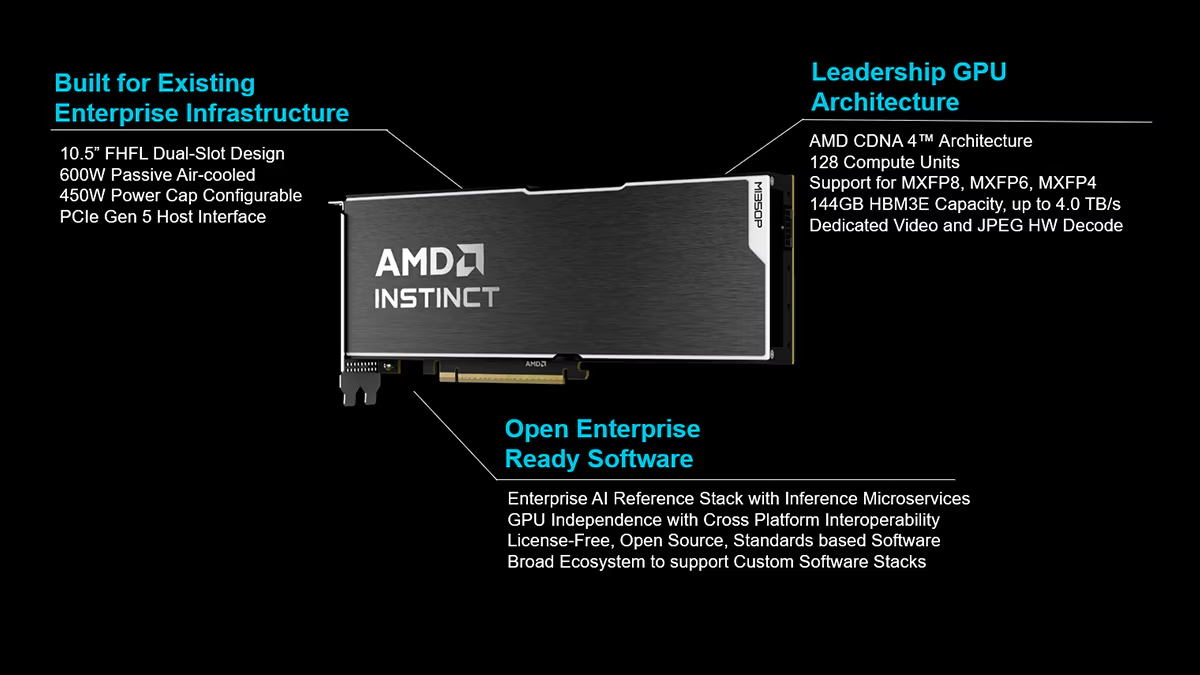

AMD ประกาศเปิดตัวการ์ดเร่ง AI รุ่นใหม่ AMD Instinct MI350P ในรูปแบบการ์ด PCIe แบบ dual‑slot ที่ออกแบบมาสำหรับเซิร์ฟเวอร์ระบายความร้อนด้วยอากาศแบบปกติ ชูจุดเด่น “เสียบใส่แร็กเดิมแล้วลุย AI ได้ทันที” เพื่อลดต้นทุนและความซับซ้อนสำหรับองค์กรที่ต้องการขยายกำลังประมวลผล AI โดยไม่ต้องยกเครื่องดาต้าเซ็นเตอร์ใหม่ทั้งหมด

ดีไซน์แบบ PCIe เน้นเสียบแทนได้ทันทีในแร็กเดิม

AMD ระบุว่า Instinct MI350P PCIe เป็นการ์ดเร่ง AI แบบ dual‑slot ที่ออกแบบมาให้ใช้งานกับเซิร์ฟเวอร์ air‑cooled มาตรฐาน สามารถติดตั้งได้สูงสุดถึง 8 ใบต่อระบบ เหมาะกับงาน inference และ RAG (Retrieval‑Augmented Generation) ทั้งโมเดลขนาดเล็ก กลาง ไปจนถึงโมเดลขนาดใหญ่ในระดับองค์กร

แนวทางของ AMD นี้เพื่อจับกลุ่มองค์กรที่ประสิทธิภาพของ CPU เริ่มชนเพดานแต่อาจยังไม่พร้อมลงทุนแพลตฟอร์ม GPU accelerator แบบครบชุดที่ต้องปรับโครงสร้างด้านการจ่ายไฟและระบบระบายความร้อนครั้งใหญ่ ทำให้ MI350P PCIe กลายเป็นอีกทางเลือกที่เน้น “เพิ่มการ์ดลงระบบเดิมแล้วขยาย AI ได้ทันที”

สเปกและประสิทธิภาพ: สูงสุด 4,600 TFLOPS ที่ MXFP4

จุดขายหลักของ Instinct MI350P PCIe คือประสิทธิภาพด้าน AI ต่อหนึ่งการ์ด โดย AMD ให้ตัวเลขประมาณการไว้ดังนี้

- ประสิทธิภาพ AI ที่ precision MXFP4 สูงสุด 4,600 TFLOPS (ตัวเลข peak)

- ค่าประสิทธิภาพทั่วไปที่ MXFP4 ราว 2,299 TFLOPS ต่อการ์ด

- หน่วยความจำ HBM3E ความจุ 144GB แบนด์วิดธ์สูงสุดราว 4TB/s

AMD ชูว่า MI350P PCIe ให้ค่า TFLOPS ในระดับนำหน้าการ์ด PCIe สำหรับงาน AI ฝั่งองค์กรในตลาดปัจจุบัน พร้อมเน้นว่าตัวเลขประสิทธิภาพยังเป็นค่าประมาณจากวิศวกรรมของ AMD ณ เดือนเมษายน 2026 และอาจมีการเปลี่ยนแปลงได้ในอนาคต

รองรับ precision หลากหลาย พร้อม MXFP6/MXFP4 และ sparsity

เพื่อรองรับ workload AI ในองค์กรที่หลากหลาย Instinct MI350P PCIe รองรับ precision หลายระดับ ตั้งแต่ฟอร์แมตความแม่นยำต่ำไปจนถึงความแม่นยำสูงที่นิยมใช้ในงาน mission‑critical

- รองรับ native MXFP6 และ MXFP4 สำหรับงาน inference ที่เน้น throughput สูงและประหยัดทรัพยากร

- รองรับการเร่งผ่าน sparsity บน precision หลักอย่าง INT8 และ BF16 เพื่อรีดประสิทธิภาพเพิ่มเติม

- รองรับ FP8, MXFP8 และ MXFP4 ซึ่ง AMD ระบุว่าเป็นกุญแจสำคัญที่ช่วยให้องค์กรสามารถรัน workload AI สมัยใหม่ในดาต้าเซ็นเตอร์แบบ air‑cooled ทั่วไปได้

การรองรับ precision ตั้งแต่ระดับต่ำไปจนถึงสูง ทำให้ MI350P PCIe สามารถยืดหยุ่นกับทั้งโมเดลรุ่นใหม่ที่ optimize มาเพื่อ TFLOPS/วัตต์สูง ไปจนถึงโมเดลองค์กรรุ่นเก่าที่ต้องการความแม่นยำมากขึ้น

ซอฟต์แวร์และสแตก AI แบบเปิดในสไตล์ AMD

AMD ยังคงผลักดันกลยุทธ์ ecosystem แบบเปิดในฝั่ง AI อย่างต่อเนื่อง โดย Instinct MI350P PCIe ถูกวางให้ทำงานร่วมกับ “AMD enterprise AI stack” ซึ่งรองรับเครื่องมือและแพลตฟอร์มยอดนิยมสำหรับองค์กร

- รองรับ Kubernetes GPU Operator สำหรับ lifecycle management ของ GPU ในสภาพแวดล้อม container‑based

- มี AMD Inference Microservices แบบ cloud‑native

- รองรับเฟรมเวิร์ก AI อย่าง PyTorch พร้อมแนวทางย้าย workload มาอยู่บน Instinct GPU ด้วยการแก้โค้ดให้น้อยที่สุด

- AMD เปิดให้พาร์ทเนอร์ใช้ enterprise AI reference stack แบบ open‑source โดยไม่เก็บค่าไลเซนส์ เพื่อช่วยลด OPEX และให้ความโปร่งใสของซอร์สโค้ด

AMD ชี้ว่าการผสาน Instinct MI350P PCIe เข้ากับสแตกแบบเปิดและโซลูชันจากพาร์ทเนอร์ ทำให้องค์กรสามารถขึ้นระบบ AI on‑prem ได้โดยไม่มีค่าใช้จ่ายต่อโทเคนเหมือนโมเดลบริการ cloud บางรูปแบบ

โฟกัส Enterprise AI

แนวคิดหลักของ AMD คือทำให้การนำ AI เข้าสู่องค์กรไม่จำเป็นต้องเริ่มจากการยกเครื่องโครงสร้างดาต้าเซ็นเตอร์ทั้งหมดใหม่ ด้วยประสิทธิภาพของการ์ด Instinct MI350P PCIe ทำให้องค์กรสามารถ:

- ย้าย workload inference มาอยู่บน on‑prem ได้โดยไม่ต้อง rewrite โค้ดครั้งใหญ่

- ผสานเข้ากับ pipeline AI ที่มีอยู่แล้ว รวมถึง workflow แบบ agentic AI และ RAG

- ขยายสเกลงาน AI เพื่อรองรับผู้ใช้และโมเดลจำนวนมากขึ้นภายในแร็กและโครงสร้างพลังงานเดิม

AMD สรุปว่าสำหรับองค์กรที่จริงจังกับ AI โครงสร้าง on‑prem ไม่ใช่ทางเลือกที่ด้อยกว่า แต่เป็น “ข้อได้เปรียบเชิงการแข่งขัน” ด้านคอนโทรล ความปลอดภัย และความคาดเดาได้ของต้นทุน เมื่อจับคู่เซิร์ฟเวอร์อย่าง Dell PowerEdge หรือ HPE ProLiant เข้ากับ Instinct MI350P PCIe การ์ด ก็สามารถเป็นเส้นทางตรงสู่แพลตฟอร์ม AI ประสิทธิภาพสูงในองค์กรได้